OpenClaw คืออะไร ใช้ทำอะไรได้บ้าง และคนส่วนใหญ่เอาไปใช้ประโยชน์แบบไหน

OpenClaw คือ self-hosted AI agent gateway ที่เชื่อมผู้ช่วย AI เข้ากับ chat app, tools, plugins, model providers และ automation ต่าง ๆ บทความนี้สรุปว่า OpenClaw ทำอะไรได้ เหมาะกับใคร และ use case ที่น่าจะเจอบ่อยที่สุดคืออะไร

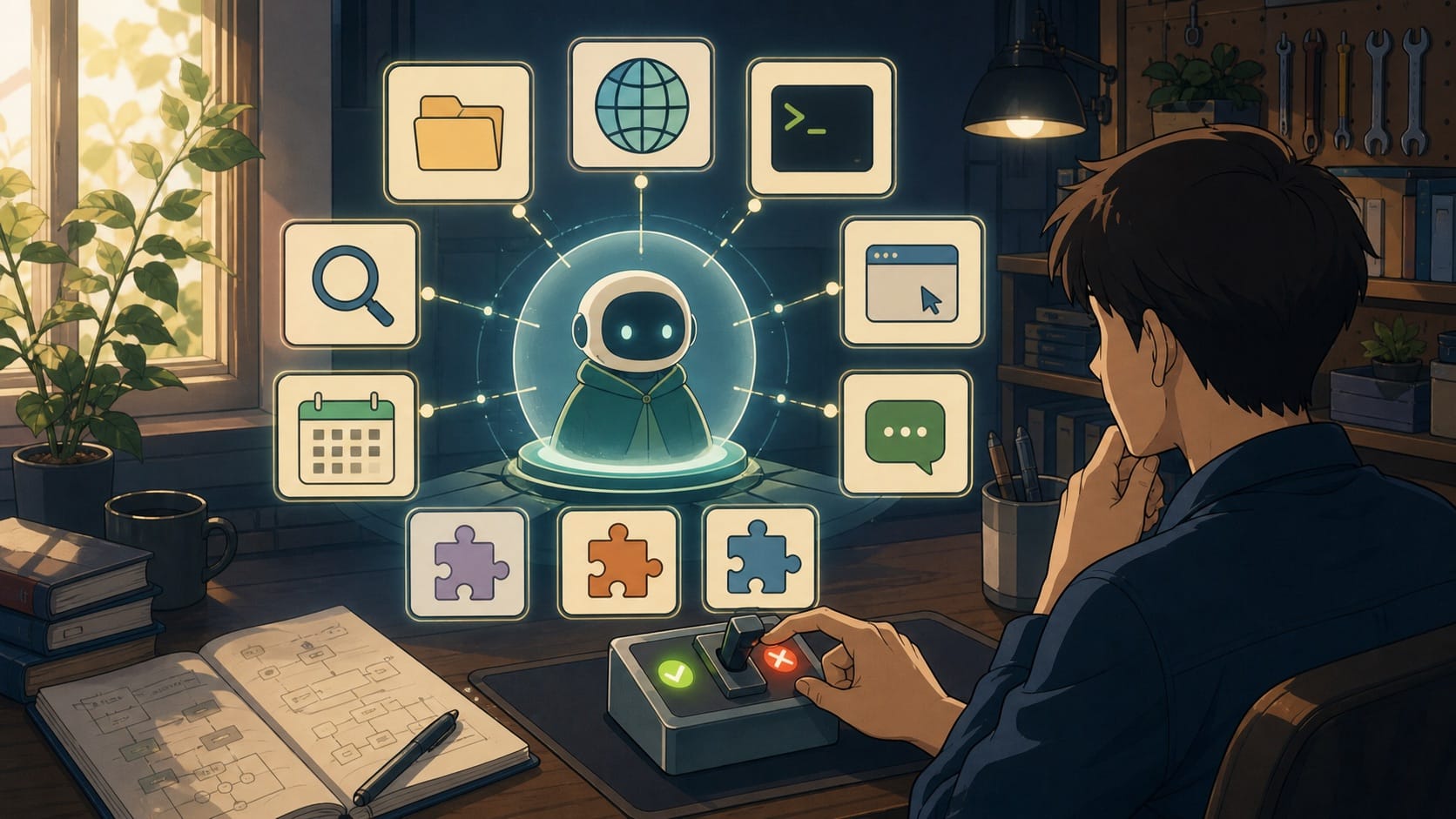

ช่วงหลังผมเห็นชื่อ OpenClaw ผ่านตาบ่อยขึ้นในกลุ่มคนที่สนใจ AI agent, automation และ personal assistant ที่ไม่อยากติดอยู่กับแอปใดแอปหนึ่งมากเกินไป คำอธิบายสั้น ๆ คือ OpenClaw เป็นตัวกลางที่ทำให้เราคุยกับ AI agent ผ่าน chat app ที่ใช้อยู่แล้ว และให้ agent เรียกใช้เครื่องมือจริงได้ เช่น browser, file, shell command, web search, message, automation job หรือ plugin อื่น ๆ

ถ้าพูดให้เห็นภาพ OpenClaw ไม่ใช่แค่ chatbot อีกตัว แต่เป็น gateway สำหรับต่อ "สมอง" ของ AI เข้ากับ "มือ" ที่ทำงานได้จริง โดยผู้ใช้ยังเป็นคนกำหนดว่า agent เห็นอะไร เรียกใช้ tool อะไร และควรมีขอบเขตแค่ไหน

สาระตั้งต้นจากแหล่งข้อมูล

ก่อนเรียบเรียงเป็นบทความ ผมแยกแก่นจากเอกสาร OpenClaw ออกมาได้ประมาณนี้

- OpenClaw เป็น self-hosted gateway สำหรับ AI agents ไม่ใช่แค่ chatbot UI

- จุดเด่นคือการเชื่อม chat channels เช่น Telegram, WhatsApp, Slack, Discord และ WebChat เข้ากับ agent ที่รันผ่าน Gateway

- Agent สามารถเรียกใช้ tools ได้ เช่น file I/O, browser control, web search, code execution, shell command, scheduled jobs และ plugins

- OpenClaw รองรับ model providers หลายเจ้า เช่น OpenAI, Anthropic, Google, OpenRouter, Ollama และ LM Studio ขึ้นกับการตั้งค่าของผู้ใช้

- รูปแบบการใช้งานที่เห็นชัดที่สุดคือ personal AI assistant ผ่าน chat app, developer automation, second brain และ scheduled task

- เมื่อ agent มีสิทธิ์เรียกใช้ tools จริง ความเสี่ยงด้าน prompt injection, API key exposure, data leakage, permission และ misconfiguration ต้องถูกออกแบบตั้งแต่แรก

OpenClaw คืออะไร

จากเอกสารทางการ OpenClaw นิยามตัวเองเป็น self-hosted gateway สำหรับ AI agents ที่เชื่อม chat apps หลายตัว เช่น Discord, Google Chat, iMessage, Matrix, Microsoft Teams, Signal, Slack, Telegram, WhatsApp, Zalo และช่องทางอื่น ๆ เข้ากับ AI assistant ที่รันผ่าน Gateway เดียว

คำว่า self-hosted สำคัญมาก เพราะหมายความว่าเรารัน OpenClaw บนเครื่องหรือ server ของเราเอง ไม่ใช่ฝาก workflow ทั้งหมดไว้กับบริการ hosted เพียงอย่างเดียว แน่นอนว่าการเรียก model provider เช่น OpenAI, Anthropic, Gemini, Ollama หรือ provider อื่น ๆ ยังขึ้นกับการตั้งค่าของเรา แต่ตัว gateway, session, routing, channel connection และ configuration หลักอยู่ในสภาพแวดล้อมที่เราควบคุมได้มากกว่า SaaS สำเร็จรูปทั่วไป

OpenClaw ใช้แนวคิดหลัก ๆ อยู่สามชั้น:

- Channels คือช่องทางที่เราคุยกับ agent เช่น Telegram, WhatsApp, Slack, Discord หรือ WebChat

- Tools คือความสามารถที่ agent เรียกใช้ได้ เช่น อ่านไฟล์ เขียนไฟล์ เปิด browser รัน command ค้นเว็บ ส่งข้อความ หรือจัดการ scheduled job

- Plugins และ skills คือส่วนขยายที่เพิ่มความสามารถหรือบอก agent ว่าควรทำงานบางเรื่องอย่างไร

จุดที่น่าสนใจคือผู้ใช้ไม่ได้จำเป็นต้องเปิดหน้าเว็บเฉพาะของ OpenClaw ตลอดเวลา เราสามารถส่งข้อความจากมือถือผ่าน chat app แล้วให้ agent ทำงานบนเครื่องที่รัน Gateway อยู่ได้ ตรงนี้เป็นความต่างจาก chatbot ทั่วไปที่มักจบอยู่ในหน้าต่างสนทนา

OpenClaw ทำอะไรได้บ้าง

ถ้าดูจากเอกสาร OpenClaw มีขอบเขตกว้างพอสมควร แต่ในทางปฏิบัติผมแบ่งเป็นกลุ่มใหญ่ ๆ ได้ประมาณนี้

1. คุยกับ AI assistant จาก chat app ที่ใช้อยู่แล้ว

นี่คือ use case พื้นฐานที่สุด เราอาจคุยกับ OpenClaw ผ่าน Telegram เพราะตั้งค่าง่าย หรือผ่าน WhatsApp เพราะเป็นช่องทางที่คนใช้เยอะ เอกสาร OpenClaw ระบุว่า WhatsApp เป็น channel ที่ได้รับความนิยมมากที่สุด ส่วน Telegram มักเป็นทางเริ่มต้นที่เร็วเพราะใช้ bot token ได้ตรงไปตรงมา

ข้อดีของแนวทางนี้คือไม่ต้องเปิด dashboard หรือ IDE ทุกครั้ง ถ้าอยู่ข้างนอกแล้วอยากให้ agent สรุปอะไร เปิดงาน background หรือช่วยตรวจสถานะบางอย่าง ก็เริ่มจากมือถือได้เลย

2. ให้ agent ทำงานกับไฟล์ browser และ command line

OpenClaw มี built-in tools หลายตัว เช่น file I/O, browser control, web search, code execution, shell command, apply patch และ session management เมื่อรวมกับ model ที่เข้าใจ tool use ได้ดี มันจึงไม่ได้แค่ตอบคำถาม แต่สามารถลงมือทำงานบางอย่างได้

ตัวอย่างเช่น ให้ช่วยอ่านเอกสารใน workspace, สรุปไฟล์หลายไฟล์, เปิด browser ไปตรวจหน้าเว็บ, เขียน patch, รัน test, หรือค้นข้อมูลแล้วกลับมาสรุปให้เราอ่าน

ตรงนี้ใกล้กับแนวคิดที่ผมเคยเขียนไว้ในบทความ AI Agent กับ Cybersecurity: ผู้ช่วยที่ดี หรือ Attack Surface แบบใหม่ คือเมื่อ agent มี tool แล้ว มันมีประโยชน์ขึ้นมาก แต่ attack surface ก็เพิ่มขึ้นพร้อมกัน

3. ทำ automation และ scheduled task

OpenClaw มีแนวคิดเรื่อง scheduled tasks, background tasks, standing orders, hooks และ heartbeat เพื่อให้ agent ทำงานบางอย่างเองตามเวลา หรือตอบสนองต่อ event บางประเภทได้

ตัวอย่าง practical เช่น:

- ส่ง daily briefing ตอนเช้า

- เตือนงานในอีก 20 นาที

- ตรวจ inbox หรือ calendar เป็นระยะ

- รัน weekly analysis แล้วส่งสรุปกลับมา

- ตรวจสถานะงาน background หรือ sub-agent

- ใช้ standing order เพื่อบังคับกฎบางอย่างในทุก session

ถ้าใช้อย่างพอดี นี่จะคล้าย personal operations layer ที่ช่วยลดงานจุกจิกได้เยอะ แต่ถ้าเปิดกว้างเกินไปก็อาจกลายเป็น automation ที่ทำงานผิดโดยไม่มีใครเห็นทัน

4. ต่อ model provider หลายเจ้า

OpenClaw รองรับ model providers หลายแบบ ตั้งแต่ OpenAI, Anthropic, Google, OpenRouter, Ollama, LM Studio และ provider อื่น ๆ เอกสารยังพูดถึง model fallback, model allowlist และการเลือก model ต่อ session

ข้อดีคือเราสามารถแยกงานตามความเหมาะสม เช่น งานสำคัญใช้ model ที่เก่งกว่า งานเบาใช้ model ที่ถูกกว่า หรือใช้ local model ในบางกรณีที่ไม่อยากส่งข้อมูลออกนอกเครื่อง แต่ในทางปฏิบัติเรื่องนี้ต้องคิดเรื่อง cost, latency, data policy และความสามารถของแต่ละ model ด้วย

รูปแบบการใช้ประโยชน์ที่คนใช้เยอะที่สุด

ข้อมูลที่เป็นตัวเลขสถิติชัด ๆ ว่า use case ไหน "คนใช้เยอะที่สุด" ยังไม่เห็นจากเอกสารทางการ ดังนั้นส่วนนี้ควรอ่านเป็นข้อสังเกตจากเอกสาร OpenClaw, หน้า showcase และรูปแบบที่ community พูดถึงบ่อย ไม่ใช่ตัวเลขยืนยันเชิงสถิติ

แต่ถ้าดูจากสัญญาณที่มี รูปแบบที่น่าจะเจอบ่อยที่สุดคือ personal AI assistant ผ่าน chat app โดยเฉพาะการใช้ Telegram หรือ WhatsApp เป็น remote control ให้ agent ทำงานบนเครื่องของเรา

เหตุผลที่ use case นี้น่าจะมาแรงคือมันแก้ปัญหาง่ายและเห็นผลเร็ว เราไม่ต้องสร้างระบบใหม่ทั้งหมด แค่เชื่อมช่องทางสนทนาที่ใช้อยู่แล้วกับ agent ที่มี memory, tools และ context ของเรา จากนั้นเริ่มให้ช่วยงานเล็ก ๆ เช่น สรุปข้อมูล, หาไฟล์, ร่างข้อความ, ตรวจ calendar, อ่าน inbox, สร้าง reminder หรือทำ task บางอย่างใน workspace

รองลงมาคือ developer automation เช่น สั่งจากมือถือให้ agent ตรวจ repo, รัน test, แก้ bug เบื้องต้น, เปิด PR หรือช่วยทำเอกสาร spec ข้อดีคือ developer เข้าใจ workflow และ risk ของ tool use อยู่แล้ว จึงมักเห็นประโยชน์เร็วกว่า user ทั่วไป

อีกกลุ่มที่น่าสนใจคือ personal knowledge และ second brain เช่น เชื่อมกับ notes, documents หรือ memory wiki เพื่อให้ agent ช่วยจดจำบริบท ค้นข้อมูลเดิม และเชื่อมโยงเรื่องที่เคยคุยกันไว้ ตรงนี้มีประโยชน์มากสำหรับคนทำงานคนเดียว consultant หรือ creator ที่มีข้อมูลกระจัดกระจาย

ใครน่าจะเหมาะกับ OpenClaw

OpenClaw น่าจะเหมาะกับคนที่มีลักษณะประมาณนี้:

- ใช้ AI บ่อย และอยากให้ AI ทำงานข้ามเครื่องมือได้มากกว่า chatbot ปกติ

- เป็น developer, power user, consultant หรือคนทำงาน automation ที่ไม่กลัวการตั้งค่าเอง

- ต้องการควบคุม gateway, config, channels และ tool permissions ด้วยตัวเอง

- มี workflow ที่ทำซ้ำบ่อย เช่น report, inbox, calendar, research, coding, documentation หรือ homelab operations

- เข้าใจว่าการให้ agent มีสิทธิ์ทำงานจริงต้องมีขอบเขตและ review

แต่ถ้าผู้ใช้ต้องการแค่ถามตอบทั่วไป หรือไม่อยากดูแล server, token, channel pairing, plugin, model provider และ security setting เอง เครื่องมือสำเร็จรูปอาจเหมาะกว่า OpenClaw ในช่วงเริ่มต้น

ข้อควรระวัง

OpenClaw เป็นเครื่องมือที่น่าสนใจมาก แต่ต้องมองด้วยสายตาแบบ security ด้วย เพราะ agent ที่อ่านข้อความจาก chat app แล้วเรียกใช้ tools ได้จริง มีความเสี่ยงมากกว่า chatbot ธรรมดา

หน้า Trust ของ OpenClaw เองก็พูดถึง threat model หลายหมวด เช่น prompt injection, tool argument injection, privilege escalation, API key exposure, system prompt disclosure, workspace exposure, memory leakage, data exfiltration, SSRF, gateway exposure, logging sensitive data, misconfiguration และ supply chain risk จาก skills หรือ extensions

แปลเป็นข้อปฏิบัติ ผมจะเริ่มแบบนี้:

- เปิดใช้เฉพาะ channel ที่จำเป็นก่อน

- ใช้ allowlist สำหรับคนหรือกลุ่มที่ส่งคำสั่งได้

- แยก workspace สำคัญออกจาก workspace ทดลอง

- จำกัด tools ที่ agent ใช้ได้ โดยเฉพาะ

exec, file write, browser automation และ message sending - ใส่ approval gate สำหรับ action ที่กระทบข้อมูล ระบบ production เงิน หรือลูกค้า

- แยก API key และ account ที่ใช้กับ agent ออกจาก account หลักเท่าที่ทำได้

- ตรวจ log และ task history เป็นระยะ

ถ้าจะต่อกับงาน security หรือข้อมูลลูกค้า ผมจะอ่านคู่กับบทความ ใช้ LLM ในงาน Security Operations ได้จริงแค่ไหน และจุดไหนยังไม่ควรฝากความหวัง เพราะหลักคิดคล้ายกันมาก: ให้ AI ช่วยเตรียมงานได้ แต่ action สำคัญต้องมีคนคุม

สรุป

OpenClaw คือแนวทางที่น่าสนใจของ personal AI assistant ยุคใหม่ เพราะมันไม่ได้พยายามเป็นแค่แอปแชต แต่เป็น gateway ที่เชื่อม chat apps, agents, tools, plugins, model providers และ automation เข้าไว้ด้วยกัน

ประโยชน์หลักคือทำให้ AI อยู่ใกล้ workflow จริงมากขึ้น เราสั่งงานจากมือถือได้ ให้ agent ทำงานกับไฟล์ browser command line และ scheduled tasks ได้ และสามารถต่อยอดเป็น personal operations layer สำหรับงานประจำวันได้

แต่จุดแข็งนี้ก็เป็นจุดที่ต้องระวังที่สุดเหมือนกัน ยิ่ง agent ทำอะไรได้มาก ยิ่งต้องออกแบบ permission, approval, logging และ data boundary ให้ชัด OpenClaw จึงเหมาะกับคนที่อยากได้ AI assistant ที่ลงมือทำงานได้จริง และพร้อมรับผิดชอบการตั้งค่าความปลอดภัยของมันอย่างจริงจัง

สำหรับผม OpenClaw น่าสนใจที่สุดในฐานะ "remote control สำหรับ AI agent ที่อยู่บนเครื่องของเรา" ไม่ใช่เพราะมันตอบเก่งกว่า chatbot เสมอไป แต่เพราะมันเริ่มเปลี่ยน AI จากหน้าต่างถามตอบ ให้กลายเป็นระบบปฏิบัติการเล็ก ๆ ของงานส่วนตัวและงาน technical ที่เราดูแลเองได้

อ่านต่อที่เกี่ยวข้อง

- AI Agent กับ Cybersecurity: ผู้ช่วยที่ดี หรือ Attack Surface แบบใหม่

- ใช้ LLM ในงาน Security Operations ได้จริงแค่ไหน และจุดไหนยังไม่ควรฝากความหวัง

- ภัยเงียบจาก Shadow AI: เมื่อพนักงานใช้เครื่องมือ AI โดยที่ฝ่าย IT ไม่รู้ตัว